@陌上花开 是不是数据太多了,一次插入的时间太久了,然后就超时了,或者之前拿的mysql连接没有关闭导致连接数太多就超时了,可以看一下数据库的当前连接数是多少

- spark yarn 连接 MySQL 总是连接超时?

- spark 读取 hbase 40 亿数据。怎么读取性能更高?

- spark yarn 连接 MySQL 总是连接超时?

- 请问 hbase 的二级索引用 Elasticsearch 时是不是用 es 去映射 hbase 的列字段?

- 请问 hbase 的二级索引用 Elasticsearch 时是不是用 es 去映射 hbase 的列字段?

- hive 查询一个 2 亿数据的表,非常慢,有什么办法设置查询?

- spark 读取 hbase 40 亿数据。怎么读取性能更高?

- spark 读取 hbase 40 亿数据。怎么读取性能更高?

- hive 查询一个 2 亿数据的表,非常慢,有什么办法设置查询?

- 请问 hbase 的二级索引用 Elasticsearch 时是不是用 es 去映射 hbase 的列字段?

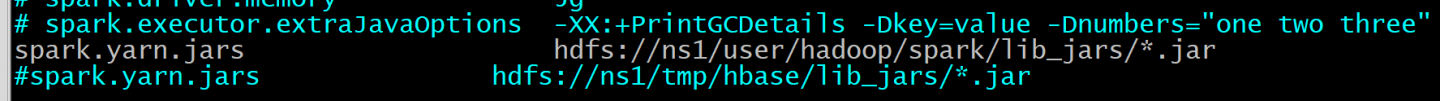

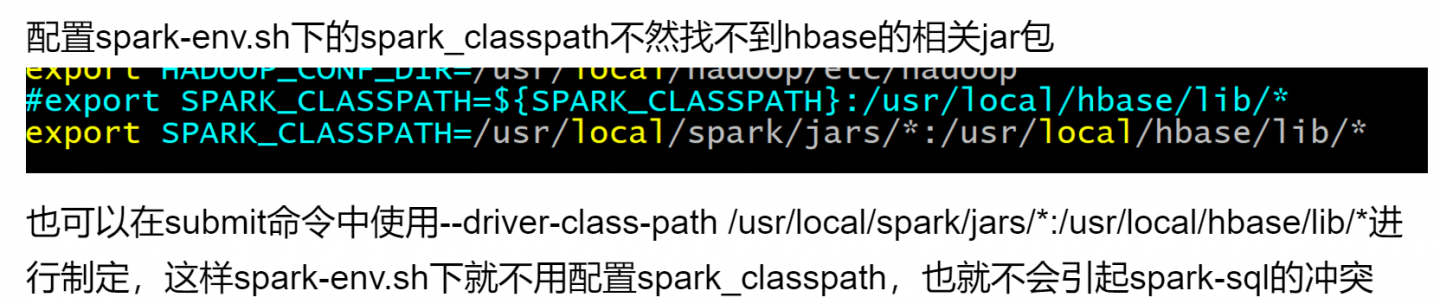

- spark 程序 yarn 运行报错?

- nodemanager 无法访问,怎么办?

- spark 程序 yarn 运行报错?

- nodemanager 无法访问,怎么办?

- spark 程序 yarn 运行报错?