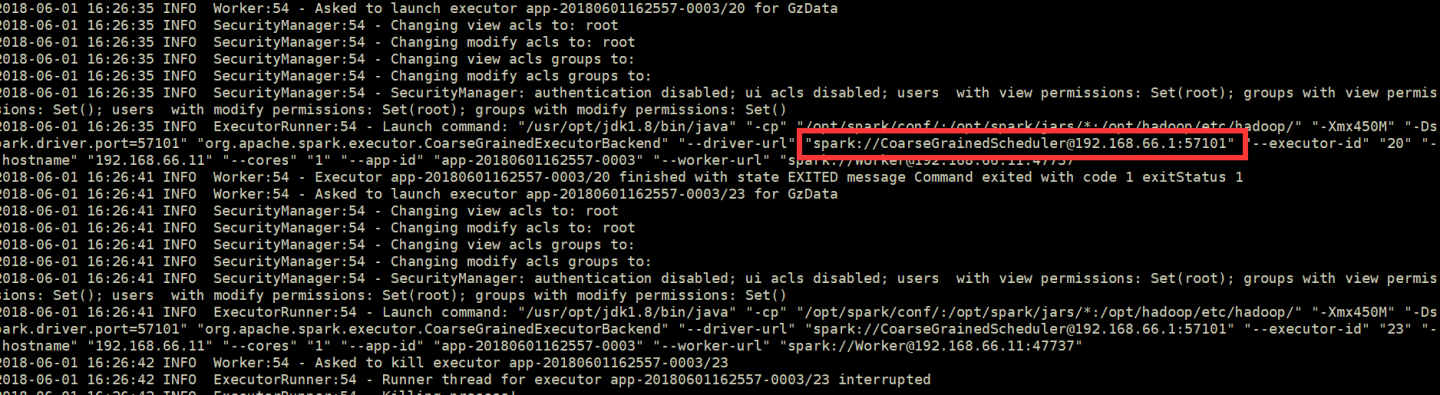

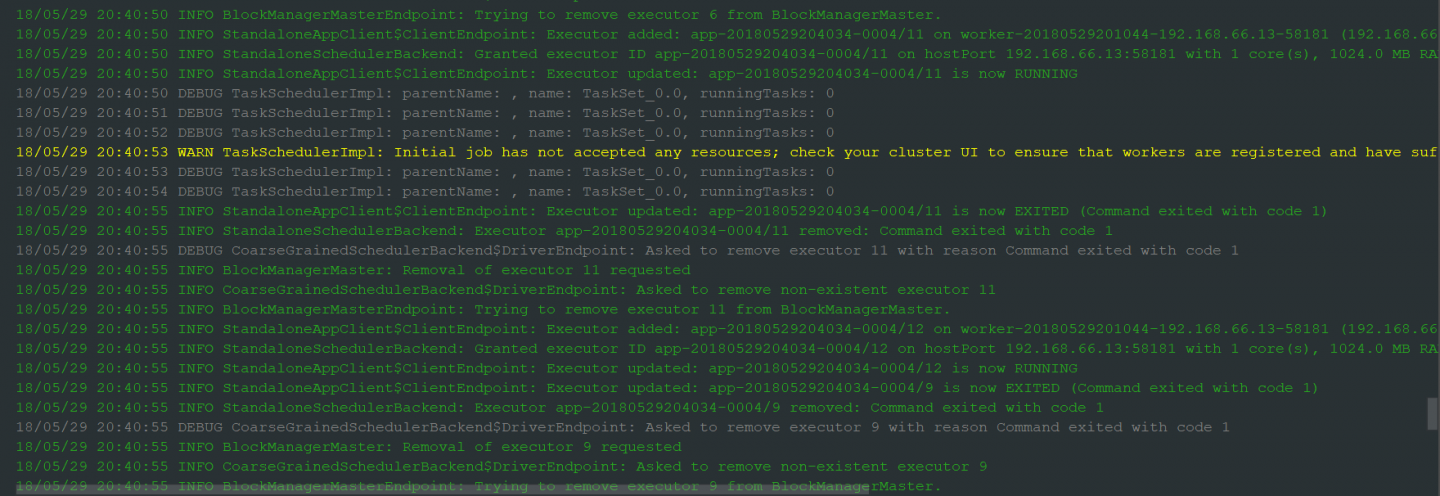

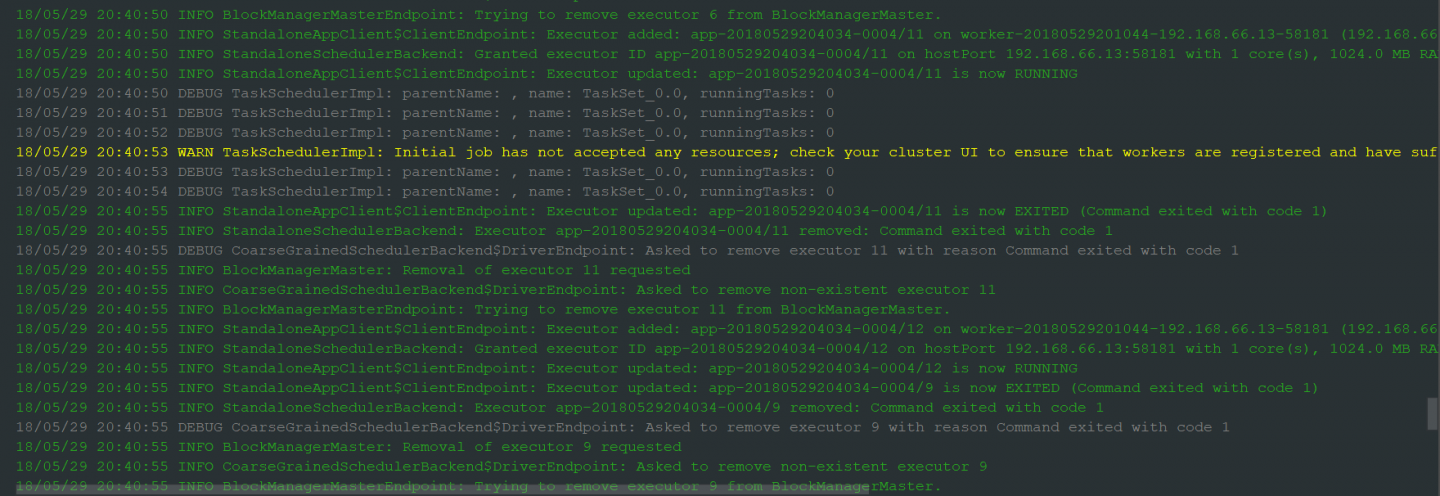

本地连接虚拟机上的spark集群,一直出现这样的日志,好像一直在不停的分配重试task,然后又回收任务,就是不执行任务,也没有错误信息,请大牛帮忙解答一下,谢谢!

spark版本是2.3的,集群没有问题,在集群上执行Spark Pi测试都是正常的。

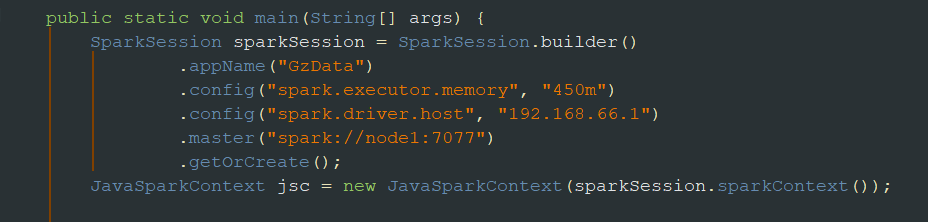

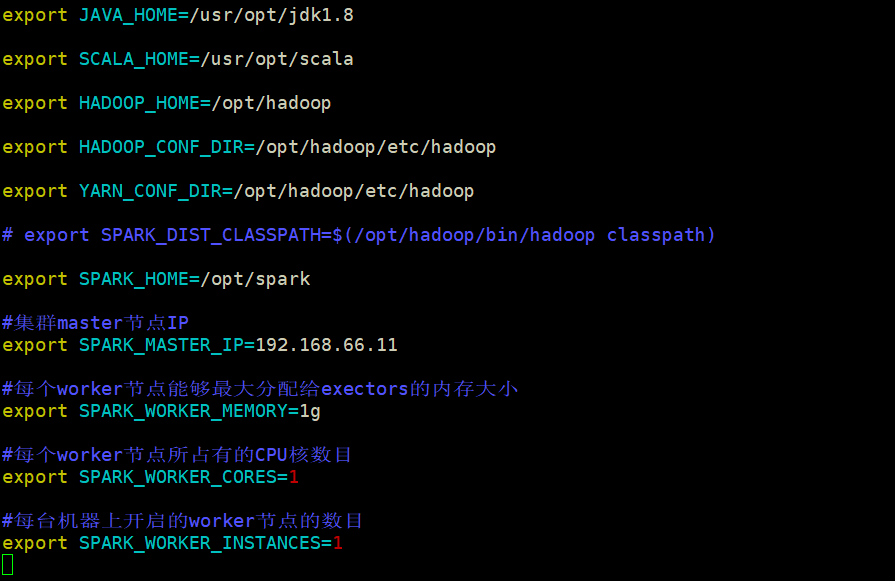

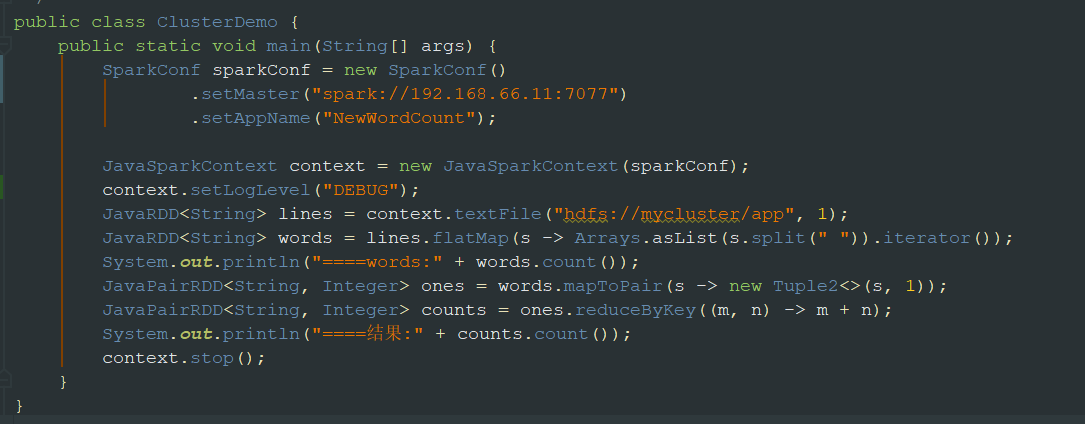

代码

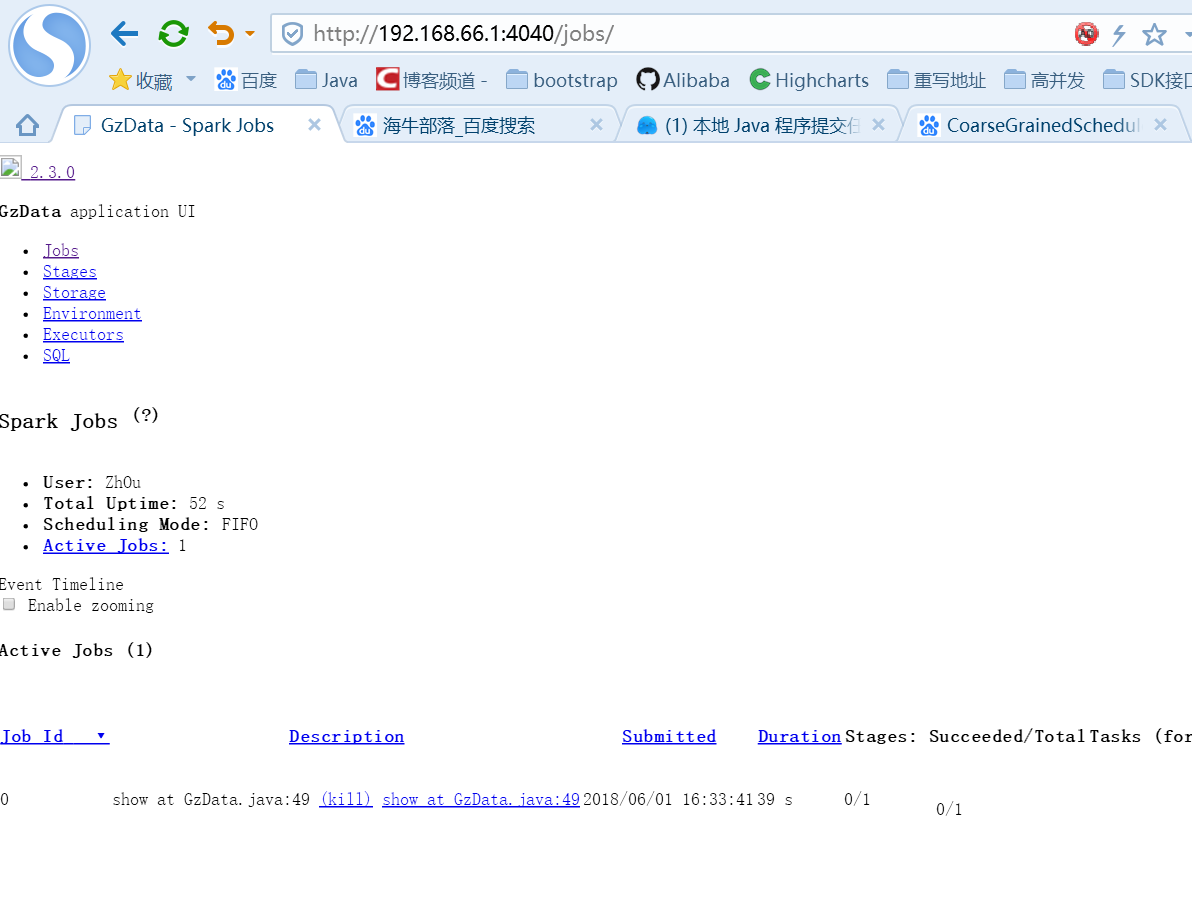

结果

spark配置

本地连接虚拟机上的spark集群,一直出现这样的日志,好像一直在不停的分配重试task,然后又回收任务,就是不执行任务,也没有错误信息,请大牛帮忙解答一下,谢谢!

spark版本是2.3的,集群没有问题,在集群上执行Spark Pi测试都是正常的。

代码

结果

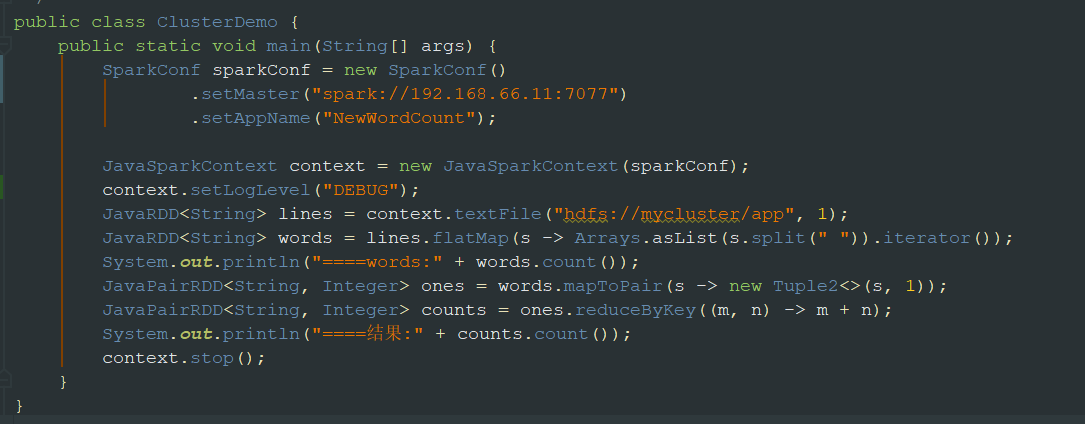

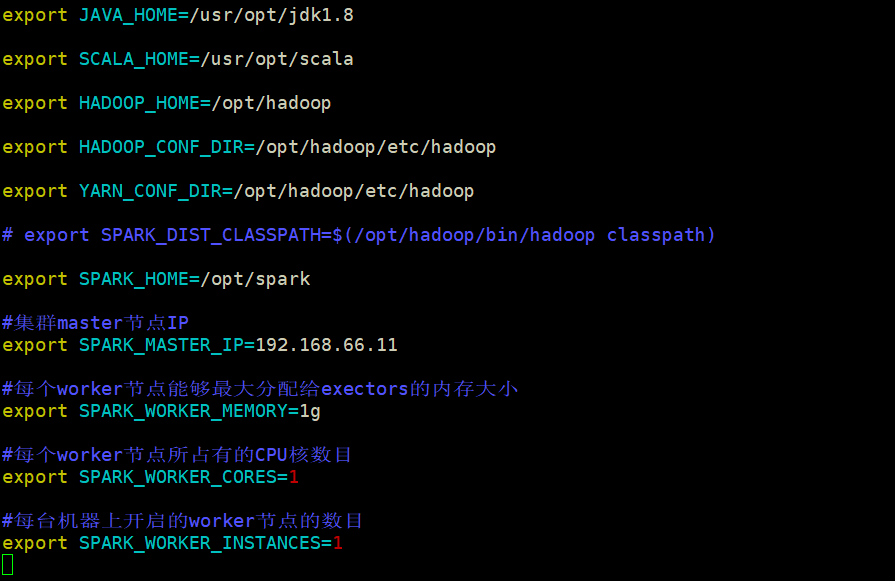

spark配置

好像是你的任务找不到你的节点位置,应该是你的本地spark配置缺少这样的信息

虚拟机网络是NAT连接,设置了spark.driver.host,driver地址确实改变了。但是问题还是没有变化,点击进去查看任务详情,很多资源找不到,就像是第三张图那样。本地也配置了Spark,cmd中也可以调用spark命令。感觉像是本地问题,但是本地也配置了SPARK_HOME。访问本地4040端口,就会出现下面的问题,请教一下这个怎么解决?不管怎么样,都非常感谢您这几天的持续解答":+1: "